天图万境发布轻舟空间智能大模型,AI类脑MoE框架首次亮相

- +1 你赞过了

【天极网IT新闻频道】6月27日,在首届中国·重庆科技电影周的高峰论坛上,天图万境公司震撼发布了其创新成果——“轻舟空间智能大模型”。这一突破性的AI技术,标志着人机交互方式的重大转变,从传统的提示词输入,迈向了能够主动识别空间环境并具备自我决策能力的新智元时代。

现有的AI大模型,人机交互方式主要是以提示词输入为主。但下一代AI,则需要其具备主动识别空间环境的能力,理解人类意图并具备一定的自我决策和自我行为能力。这就需要机器像人类一样拥有可以观看的眼睛,听声的耳朵,*终将这些信息输送给大脑,并做出决策和行动。

为此,我们就不仅仅需要会对话的AI,更需要能够通过视听感知周围的AI,能够做出行动和决策的AI。因此,一个全新的AI计算机视觉(AICV)+AI听觉的感知时代正在到来。天图万境此次发布的空间智能大模型“轻舟”,即从这个角度出发在补齐AI的感知视听能力。

什么是计算机的感知能力?天图万境创始人图拉古,在论坛现场分享了他和团队研究的新理论,即让AI拥有跟人类一样的视觉、听觉,并以此为基础认识世界,建立对三维空间的认知能力。

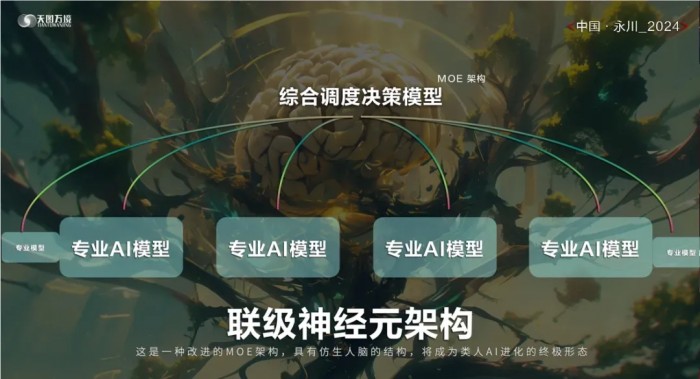

AI空间智能大模型是一种改进的MoE框架,MoE 起源于 1991 年的论文《Adaptive Mixture of Local Experts》。该论文的理念与集合方法类似,都是为由不同网络组成的系统提供监督程序,每个网络处理不同的训练集子集。每个独立的网络或者说专家擅长于输入空间的不同区域。至于如何选择专家这个问题,是由门控网络来决定每个专家网络的权重。在训练过程中,专家网络和门控网络都要接受训练,这种框架也被称为专家混合 (MoE) ,是 LLM 中常用的一种技术,旨在提高其效率和准确性。

图拉古认为,在 AI视听领域,它应该是一种改良的类脑框架,主要是关注于主动决策和主动分析,它需要把每一个专业的垂直 AI 模型作为一个专家神经元看待,互相连接,彼此通讯,这就像大脑一样,有负责语言的区域,有负责音乐的区域,有负责行动的区域,有负责平衡的区域,他们虽然都在一个头颅内,可是各自却是独立的,*终靠神经中枢来协调并做出反应,多个区域之间靠生物电通讯。

AI感知视听(人工智能视觉听觉)技术和全新改进的MoE框架,称之为“联级神经元”框架,正是模拟人类的大脑多区域总决策行为。让人工智能具有与人类相似的视觉、听觉感受,再通过联级神经元框架,像人的“大脑”中枢系统一样,将这些AI能力联接起来,实现对世界的记忆力、理解力、分析力,并做主动决策和行动。

AI感知视听技术和联级神经元框架与其他大部分大模型所带来的区别主要是主动性和被动性的区别。图拉古表示,天图万境的团队希望创造一个更加理想的空间智能,让机器为我们做事,或者帮我们做事。

天图万境的“轻舟”,不仅仅是一个技术产品,它代表了AI领域的一次重大进步,预示着一个更加智能、更加主动的AI时代的到来。随着“轻舟”被广泛应用,AI技术将深刻改变我们的工作和生活。

类型:广告最新资讯

热门视频

新品评测

X

X

微博认证登录

微博认证登录

QQ账号登录

QQ账号登录

微信账号登录

微信账号登录